人工智能惡意軟件 利用AI模型隱藏惡意的新型威脅

隨著人工智能技術(shù)的飛速發(fā)展,其在醫(yī)療、教育、交通等領(lǐng)域的應(yīng)用日益廣泛。技術(shù)的發(fā)展往往伴隨著新的挑戰(zhàn),人工智能惡意軟件的出現(xiàn),便是這一背景下不容忽視的網(wǎng)絡(luò)安全新威脅。這類惡意軟件能夠利用人工智能模型自身的復(fù)雜性和隱蔽性,來隱藏其惡意意圖與行為,對人工智能應(yīng)用軟件開發(fā)與部署構(gòu)成了前所未有的風險。

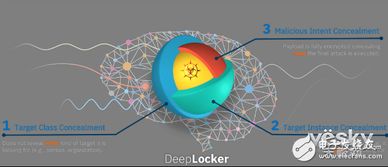

傳統(tǒng)惡意軟件通常依賴于已知的漏洞或簡單的代碼混淆技術(shù)來逃避檢測。而人工智能惡意軟件則更為高級,它能夠?qū)阂獯a或行為“嵌入”到AI模型的參數(shù)、結(jié)構(gòu)或訓(xùn)練數(shù)據(jù)中。例如,攻擊者可以訓(xùn)練一個看似正常的圖像分類模型,但其內(nèi)部卻包含了用于數(shù)據(jù)竊取、系統(tǒng)破壞或后門開啟的惡意邏輯。由于AI模型本身是一個復(fù)雜的“黑箱”,其內(nèi)部運作機制往往難以完全解釋,這使得檢測嵌入其中的惡意代碼變得異常困難。

這種隱蔽性帶來了多重風險。它威脅著人工智能應(yīng)用軟件的安全開發(fā)生命周期。開發(fā)者在集成第三方AI模型或使用預(yù)訓(xùn)練模型時,可能無意中引入了惡意組件。它挑戰(zhàn)了現(xiàn)有的安全檢測體系。傳統(tǒng)的基于特征碼或行為分析的防病毒軟件,可能無法有效識別這種深度整合在模型內(nèi)部的威脅。它可能被用于發(fā)起高度針對性的高級持續(xù)性威脅(APT)攻擊,危害關(guān)鍵基礎(chǔ)設(shè)施、企業(yè)機密乃至國家安全。

面對這一新興威脅,人工智能應(yīng)用軟件的開發(fā)者和安全社區(qū)需要采取多層次的防御策略。

- 供應(yīng)鏈安全與模型審計:建立嚴格的AI模型供應(yīng)鏈安全管理規(guī)范。對引入的第三方模型、訓(xùn)練數(shù)據(jù)集和開源庫進行嚴格的安全審計與驗證,確保其來源可信。推動模型“可解釋性”研究,開發(fā)能夠剖析模型內(nèi)部決策邏輯的工具,以發(fā)現(xiàn)潛在的惡意植入。

- 開發(fā)安全實踐(DevSecOps for AI):將安全考量深度融入AI應(yīng)用的開發(fā)、部署與運維全過程(即AI領(lǐng)域的DevSecOps)。這包括在模型訓(xùn)練階段監(jiān)控異常模式,在部署前進行對抗性樣本測試和惡意行為模擬,以及在運行期間持續(xù)監(jiān)控模型的輸入、輸出和資源使用情況。

- 新型檢測技術(shù)研發(fā):投資研發(fā)專門針對AI模型的安全檢測技術(shù)。例如,開發(fā)能夠分析模型參數(shù)分布異常、檢測隱蔽后門觸發(fā)機制、或識別模型在特定輸入下產(chǎn)生惡意輸出的新型安全工具。

- 行業(yè)標準與法規(guī):政府和行業(yè)組織應(yīng)加快制定關(guān)于AI模型安全性的標準、測試基準和法規(guī)框架。明確AI模型開發(fā)、提供和使用各方的安全責任,促進安全信息的共享,共同構(gòu)建抵御AI惡意軟件的生態(tài)系統(tǒng)。

- 安全意識與培訓(xùn):提升AI開發(fā)者、研究人員和最終用戶的安全意識。使其了解AI惡意軟件的潛在風險,并在日常工作中采取基本的安全預(yù)防措施,如不隨意運行來源不明的模型,定期更新和修補系統(tǒng)等。

人工智能是一把雙刃劍,它在賦能千行百業(yè)的其技術(shù)特性也可能被惡意利用。人工智能惡意軟件的出現(xiàn),標志著網(wǎng)絡(luò)攻擊進入了利用AI技術(shù)進行隱蔽和逃逸的新階段。這要求我們在擁抱AI創(chuàng)新的必須以前瞻性的眼光,構(gòu)建與之匹配的、主動的、縱深的安全防御體系。只有通過開發(fā)者、安全研究者、企業(yè)和監(jiān)管機構(gòu)的協(xié)同努力,才能確保人工智能技術(shù)在安全、可信的軌道上持續(xù)發(fā)展,真正造福社會。

如若轉(zhuǎn)載,請注明出處:http://www.hongyangtianxia.cn/product/18.html

更新時間:2026-02-27 09:13:56